C’est quoi les nits écran et combien il en faut pour une TV, un moniteur PC ou un écran lisible au soleil ? Tu l’as déjà tapé (ou presque) dans Google en comparant deux fiches techniques qui n’avaient aucun sens côte à côte. Les fabricants, eux, continuent de t’assommer de chiffres comme si 400 nits écran, 1 000 nits écran ou 2 000 nits étaient des évidences.

Alors on va faire simple : définir clairement ce que sont les nits écran, puis répondre frontalement à la vraie question – combien de nits écran sont vraiment utiles dans ton salon, sur ton bureau, ou derrière une vitrine.

On ne regarde plus un écran, on le subit. Les fabricants nous bombardent de chiffres sur la luminosité en nits écran comme s’ils vendaient des mini-supernovas de salon. Pourtant, personne ne prend vraiment le temps d’expliquer ce que signifie ce nombre quand on a, très concrètement, un téléviseur dans son salon ou un moniteur sur son bureau. Et c’est précisément là que tout se joue : à quoi servent vraiment les nits écran quand on parle d’image, de confort visuel et de HDR ?

Nits écran : la base physique, sans le bullshit

Les nits mesurent la luminance d’un écran, c’est-à-dire combien de lumière il émet par mètre carré vers tes yeux : 1 nit = 1 cd/m², point de départ obligatoire si tu veux comprendre la luminosité d’un écran autrement que par le marketing. Quand tu lis « 400 nits écran » ou « 1 000 nits écran » sur une fiche technique, ce n’est donc pas un mot à la mode, mais une mesure physique de la brillance de la dalle, qui va conditionner la lisibilité en plein jour, la dynamique HDR et… la fatigue visuelle à la fin de ta journée. À titre indicatif, un moniteur de bureau sérieux tourne souvent entre 250 et 300 nits écran, une TV HDR crédible se situe plutôt entre 400 et 1 000 nits, tandis que des écrans extérieurs explosent facilement les 1 000 nits pour rester lisibles en plein soleil.

Nits écran vs lumens : la fausse comparaison

La confusion classique, c’est de mélanger nits écran et lumens. Les lumens mesurent la quantité totale de lumière émise par une source (projecteur, ampoule), alors que les nits quantifient ce que ta rétine reçoit d’une surface d’affichage donnée. Autrement dit, tu peux avoir une source très puissante en lumens qui, étalée sur une grande surface, donnera finalement peu de nits écran, et inversement. On voit parfois des approximations du type “1 nit ≈ 3,4 lumens par mètre carré”, mais ce genre de conversion simpliste sert surtout aux tableaux comparatifs ; dans la vraie vie, pour juger un écran, tu dois regarder uniquement les nits écran, pas les lumens

J’ai déjà vécu cette scène : un client me demande de choisir entre « un écran 3 000 lumens » et « un écran 800 nits ». Sauf qu’on comparait un projecteur entrée de gamme et un moniteur IPS pour installation semi-outdoor. Sur le papier, 3 000 semble “plus” que 800. En usage réel, l’écran 800 nits écran défonçait littéralement le projecteur dès qu’on allumait les lumières : contraste stable, lisibilité nette, couleurs qui tenaient la route. Cette journée-là, j’ai définitivement arrêté de laisser les services achats décider à partir d’un PDF de specs.

Nits écran, HDR et Dolby Vision : ce que les démos ne disent pas

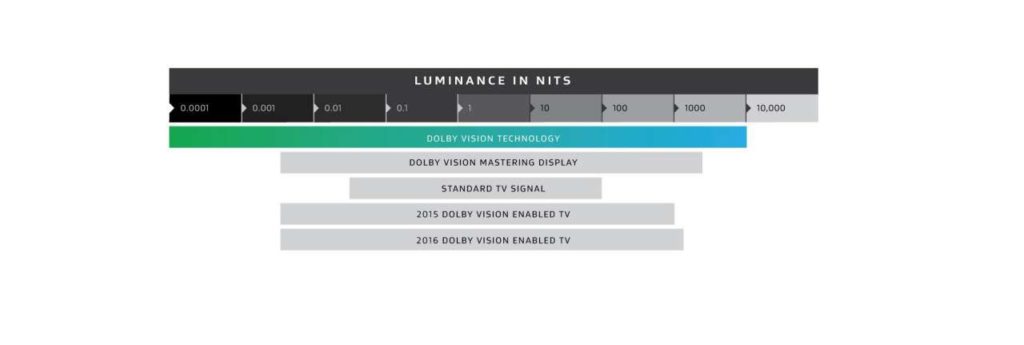

Le HDR et le Dolby Vision ont encore compliqué le débat autour des nits écran. HDR10, HDR10+, Dolby Vision définissent des plages de luminance parfois théoriques jusqu’à 10 000 nits, mais la majorité des masters HDR sont pensés autour de 1 000 à 4 000 nits, bien au-delà de ce que la plupart des téléviseurs peuvent réellement afficher. L’astuce, ce sont les métadonnées : le téléviseur lit ce que le signal lui demande en termes de nits écran, constate qu’il ne pourra pas monter si haut, et applique un tone-mapping pour compresser la dynamique sans tout cramer. Résultat : deux TV à 800 nits écran peuvent produire des images HDR totalement différentes, selon la façon dont elles gèrent cette compression et le local dimming. Le “nombre de nits écran” est une base, pas un verdict.

Autre anecdote, un peu humiliante celle-là : j’ai passé un week-end à vanter les mérites d’un téléviseur 1 500 nits écran à un studio qui cherchait un moniteur de contrôle. Sur le papier, c’était parfait. En pratique, les noirs grimpaient dès qu’on sollicitait les hautes lumières, le blooming détruisait les détails dans les scènes sombres, et les coloristes n’arrivaient pas à faire confiance à ce qu’ils voyaient. On a fini par revenir à un écran de référence autour de 300 nits écran, calibré à la perfection. Moins de spectacle, infiniment plus de vérité.

Combien de nits écran selon l’usage ?

L’œil humain n’aime pas les fiches techniques, il aime la cohérence. Entre 200 et 500 nits écran, tu couvres déjà la majorité des usages intérieurs confortables ; au-delà, tu gagnes surtout en lisibilité dans des conditions lumineuses agressives, tant que le contraste suit. C’est pour ça qu’un smartphone à 800 ou 1 000 nits écran reste lisible au soleil, alors qu’un PC portable à 250 nits écran devient presque inutilisable dès qu’on s’approche d’une fenêtre. Et c’est aussi pour ça qu’un écran géant en vitrine grimpe à 2 000 nits écran et plus : non pas pour “faire beau”, mais juste pour ne pas disparaître derrière les reflets.

La vraie question, au fond, n’est pas « combien de nits écran ? », mais « pour quoi faire, dans quelle lumière, et avec quel niveau d’exigence sur la fidélité de l’image ? ». Pour un poste de travail, un 27 pouces bien calibré à 250–300 nits écran est souvent idéal ; pour un salon, un bon LCD ou OLED autour de 600–800 nits écran, avec un traitement HDR abouti, donnera plus d’émotion qu’un monstre lumineux pensé pour un showroom ; pour une vitrine ou une enseigne, tu bascules dans un autre monde, celui des 1 500, 2 000, parfois 3 000 nits écran et plus.

Plus de lumière… ou plus de nuance ?

Et si la prochaine fois que tu lis “1 000 nits écran” sur un carton, tu te demandais d’abord : est-ce que j’ai vraiment besoin de plus de lumière… ou juste de plus de nuance ?